YouTube będzie oznaczał treści stworzone z użyciem AI

Obserwuj nas na instagramie:

Na oficjalnym blogu YouTube’a można przeczytać artykuł o „odpowiedzialnym podejściu do innowacji związanych ze sztuczną inteligencją”.

Nowy system obejmie wszystkich

Serwis zamierza wprowadzić obowiązkowy dla wszystkich system, który ma oznaczać materiały stworzone przy pomocy AI. Streamingowy gigant ogłosił to kilka dni temu. Nie wiadomo jeszcze, kiedy dokładnie zmiana polityki serwisu wejdzie w życie. YouTube zapowiedział też, że niektóre treści będą specjalnie oznaczone w ich playerze.

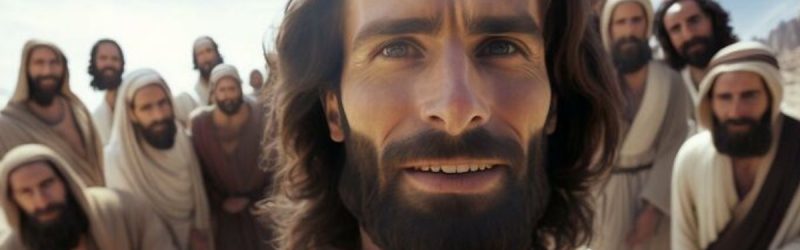

Realistyczne, ale sztuczne

Jak można przeczytać w artykule, użytkownicy YouTube’a w ciągu kilku najbliższych miesięcy zostaną poproszeni o ujawnienie, czy używali AI przy tworzeniu swoich projektów publikowanych w serwisie. Filmy tego typu, uznane za „realistyczne”, będą musiały zostać oznakowane. Nie wiadomo jednak na razie, w jaki sposób. Z oryginalnym tekstem na ten temat możecie zapoznać się TU.

Po co weryfikować użycie AI?

System ma działać na klipach dowolnej długości, włącznie z shortsami i rolkami. Oczywiście w przypadku niepoinformowania YouTube’a i wykrycia tego przez serwis, internetowym twórcom grożą karty lub zawieszenia konta. Po co YouTube chce kontrolować „prawdziwość” treści? Chodzi przede wszystkim o weryfikacje i „wyłapywanie” tych materiałów, które fałszują rzeczywistość lub powstały bez zgody umieszczonych w nich osób – a jak wiemy, od wielu miesięcy, jak nie lat, takie rzeczy dzieją się non-stop. Wystarczy wspomnieć viralowe filmiki z udziałem celebrytów, fake-newsowe ujęcia z konfliktów zbrojnych czy deepfake’ową pornografię. To część wspomnianego artykułu:

Kiedy twórcy prześlą treści, będziemy mieli możliwość selekcji. Chodzi o to, by wskazać, czy nie zawierają one realistycznie zmienionych lub fałszywych materiałów. Może to być na przykład film wygenerowany przez sztuczną inteligencję, który realistycznie przedstawia wydarzenie, które nigdy nie miało miejsca, lub treść pokazująca, że ktoś mówi lub robi coś, czego w rzeczywistości nie zrobił. (…) Jest to szczególnie ważne w przypadkach, gdy w treści poruszane są drażliwe tematy, takie jak wybory, trwające konflikty i kryzysy w zakresie zdrowia publicznego lub osoby publiczne.

Fejkowe piosenki

Zmiany mają objąć też treści muzyczne, które zostały wygenerowane przy użyciu AI. Chodzi o przypadki, o których często piszemy na Rytmy.pl – gdy w utworze pojawia się wygenerowany przez algorytm wokal konkretnego wykonawcy. Tak było w przypadku np. piosenki Drake’a i The Weeknda, z którą wspomniani artyści nie mieli nic wspólnego, czy deepfake’owego utworu Franka Oceana, która pojawiła się w maju. Oszust sprzedał ją i zarobił w ten sposób 13 tys. dolarów!

Nie chcą się przyznawać

Warto w tym miejscu przypomnieć o ciekawych badaniach, które przeprowadziła niedawno firma Pirate Studios. Pisaliśmy o nich na początku listopada. Z rozmów z dokładnie 1141 muzykami wynikło, że ponad połowa z nich nie byłaby szczera w sprawie korzystania ze sztucznej inteligencji w swojej twórczości. 53 proc. ankietowanych stwierdziło, że obawiałoby się, co ludzie powiedzą o muzyce wspomaganej AI.

Na oficjalnym blogu YouTube’a można przeczytać artykuł o „odpowiedzialnym podejściu do innowacji związanych ze sztuczną inteligencją”. Zobacz także Co obejrzeć po „Reniferku”? Te seriale powinny wam się spodobać Początki polskiego rapu: pierwsze kasety, dissy i nadejście Scyzoryka WROsound 2024. Zagrają m.in. Małpa, susk, Bisz i Kasia Lins Nowy system obejmie wszystkich Serwis zamierza wprowadzić obowiązkowy […]

Obserwuj nas na instagramie: